TRAE 企业版 Max 模式

Max 模式旨在满足对更大上下文窗口和更复杂的工具调用能力有需求的用户。启用 Max 模式后,AI 模型的上下文窗口将显著扩大,从而支持处理更大规模的输入。

核心优势

- 超大上下文容量:上下文窗口扩展至最高 200k,让大模型更准确地理解和处理你的任务。

- 大规模工具调用:单次任务支持最多 200 轮的工具调用,适配多步骤、多依赖任务的处理。

- 大行数文件读取:一次可读取最长 750 行文件,减少分段处理频率,提高代码解析与分析效率。

使用场景

- 大型复杂项目初稿的快速生成

支持一次性引入依赖、数据结构和配置文件,直接生成可运行的全局雏形。适用于在大型项目中快速产出功能模块的初稿(包接口调用、数据结构定义等)。

- 长文档或复杂需求的解析与落地

能够理解并处理长篇 PRD、设计文档或合规协议,实现从需求理解到代码落地的连贯转化。例如:从产品或架构文档直接生成代码,或结合合约协议自动生成实现与校验逻辑。

- 跨模块或跨文件代码的理解与重构

基于更大的上下文窗口,AI 可以理解各个模块间的依赖关系,并在长链路执行中完成测试、修复和再运行。适用于 SDK/框架升级、全局命名规范调整、跨模块 API 改造等场景。

- 复杂交互或多步骤流程的自动化脚本生成

AI 可在执行过程中不断运行、捕错并修复,直至完整跑通流程。典型场景包括 CI/CD 流程生成、跨服务调用编排、自动化测试脚本编写等。

- 实时交互式开发的上下文保持

基于大上下文窗口与长链路执行能力,使 AI 能持续记忆开发过程中的历史决策。适合用于交互式调试、持续性调试或大型重构。

可用模型

下表列出了 Max 模式可用的模型,以及它们在单个对话回合中支持的上下文窗口(按 Token 计)。

| 模型名称 | Max 模式下的上下文窗口 |

|---|---|

| Doubao-Seed-Code | 200k |

| Kimi-K2-0905 | 200k |

| Deepseek-V3.1-Terminus | 128k |

| DeepSeek-V3.2 | 128k |

适用对象

订阅了 TRAE 企业版和企业专属版的用户,且席位内仍有对话次数余量或企业限额仍有余量。若席位内对话次数已用完,且企业未开通按量计费或企业限额无余量,则需要提醒企业管理员开通按量计费并充值余额。

计费说明

- 若席位内仍有剩余的对话次数,将按每次请求消耗 2 个对话次数额度来计费。

- 若席位内无剩余的对话次数,但企业已开通按量付费且企业限额仍有余量,则采用基于 Token 消耗的计费方式。Token 单价参考官方定价。

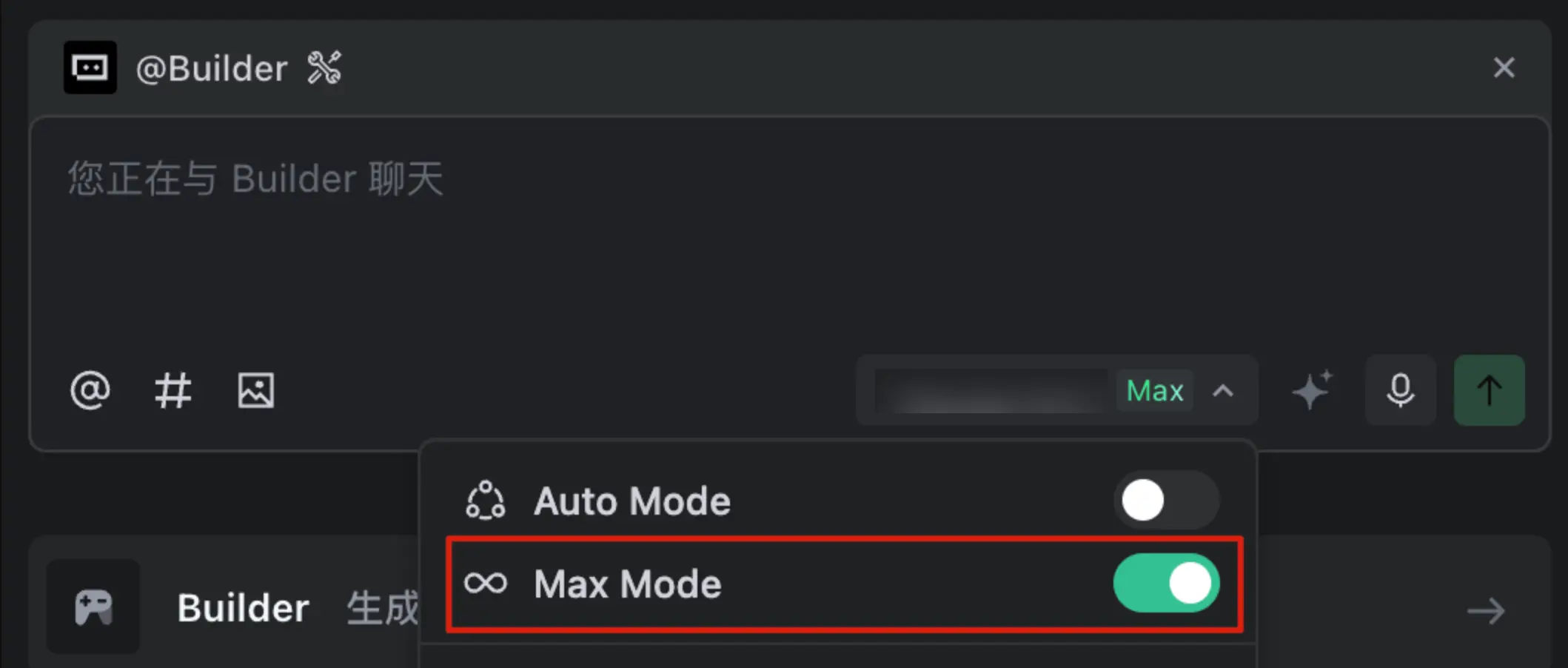

开启 Max 模式

在 AI 对话输入框右下角,点击模型名称,然后打开菜单中的 Max Mode 开关。