AI人工智能 多层神经网络

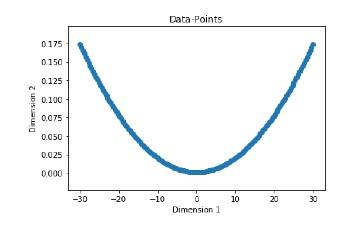

在这个示例中,我们将创建一个多层神经网络,它由多个层组成,用于提取训练数据中的潜在模式。这个多层神经网络将像一个回归器一样工作。我们将根据方程:y = 2x² + 8 生成一些数据点。

导入必要的包,如下所示:

import numpy as np

import matplotlib.pyplot as plt

import neurolab as nl根据上述方程生成一些数据点:

min_val = -30

max_val = 30

num_points = 160

x = np.linspace(min_val, max_val, num_points)

y = 2 * np.square(x) + 8

y /= np.linalg.norm(y)现在,将这个数据集重新整形,如下所示:

data = x.reshape(num_points, 1)

labels = y.reshape(num_points, 1)使用以下命令可视化并绘制输入数据集:

plt.figure()

plt.scatter(data, labels)

plt.xlabel('维度1')

plt.ylabel('维度2')

plt.title('数据点')现在,使用neurolab构建神经网络,该网络有两个隐藏层,第一个隐藏层有10个神经元,第二个隐藏层有6个神经元,输出层有1个神经元。

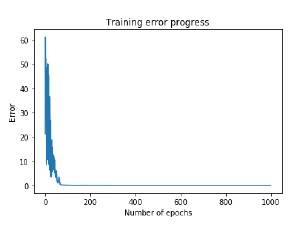

neural_net = nl.net.newff([[min_val, max_val]], [10, 6, 1])现在,使用梯度训练算法:

neural_net.trainf = nl.train.train_gd现在,训练网络,目标是在上面生成的数据上进行学习:

error = neural_net.train(data, labels, epochs = 1000, show = 100, goal = 0.01)现在,在训练数据点上运行神经网络:

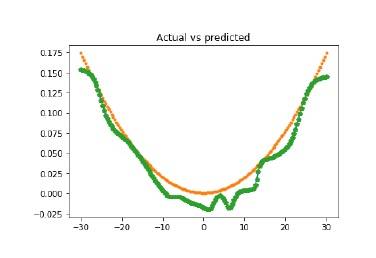

output = neural_net.sim(data)

y_pred = output.reshape(num_points)现在,进行绘图和可视化任务:

plt.figure()

plt.plot(error)

plt.xlabel('迭代次数')

plt.ylabel('误差')

plt.title('训练误差进度')现在,我们将绘制实际输出与预测输出:

x_dense = np.linspace(min_val, max_val, num_points * 2)

y_dense_pred = neural_net.sim(x_dense.reshape(x_dense.size,1)).reshape(x_dense.size)

plt.figure()

plt.plot(x_dense, y_dense_pred, '-', x, y, '.', x, y_pred, 'p')

plt.title('实际值与预测值')

plt.show()作为上述命令的结果,您可以观察到如下图表: